标题

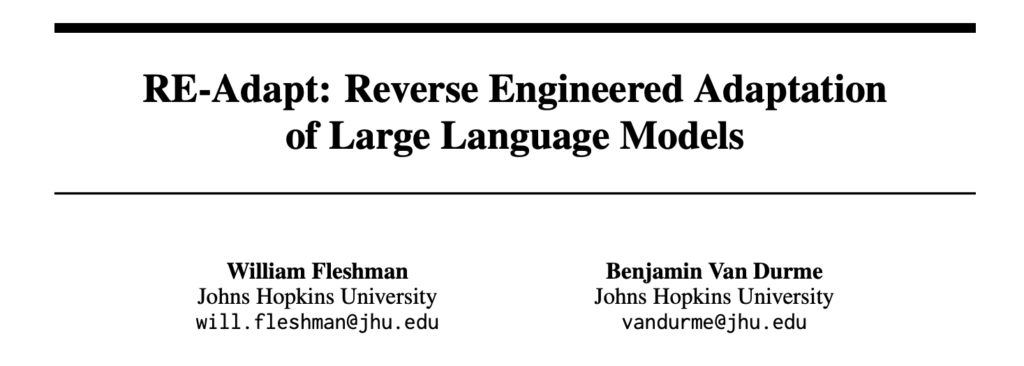

RE-Adapt: Reverse Engineered Adaptation of Large Language Models

总结

本网页介绍了一种名为 RE-Adapt 的方法,用于在不遗忘原有指令调优(instruction-tuning)的情况下,将大型语言模型(LLMs)适应新领域。

摘要

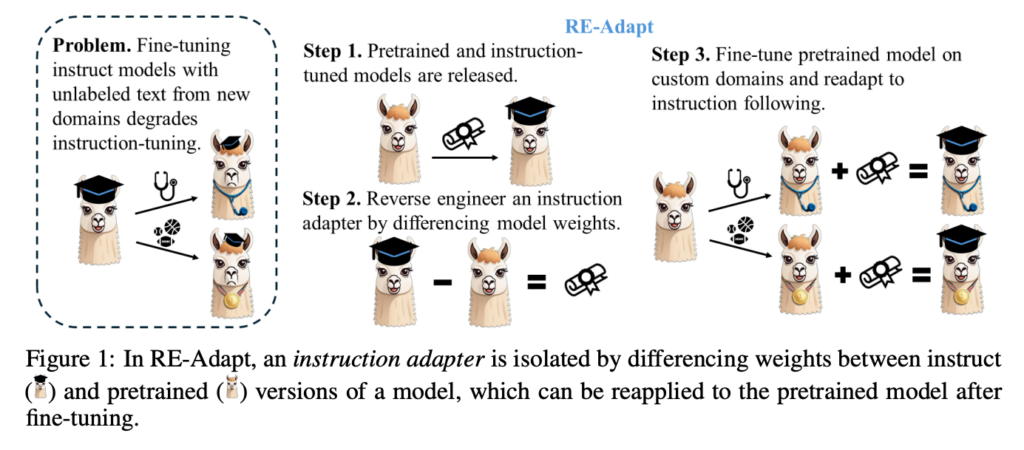

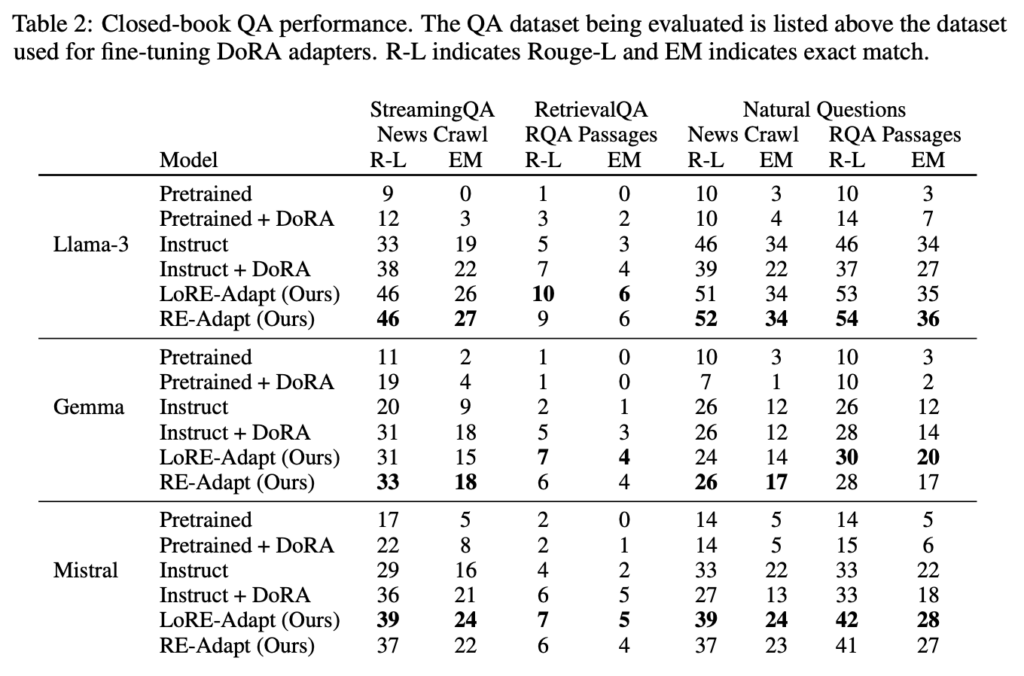

本文提出了一种名为 RE-Adapt 的方法,它通过逆向工程的方式提取了指令调优模型与其基础预训练模型之间的差异,形成了一个适配器(RE-Adapter)。这个适配器可以在不影响原有指令跟随能力的前提下,使预训练模型适应新领域的数据。RE-Adapt 还有一种低秩变体 LoRE-Adapt,它通过截断奇异值分解(SVD)来减少参数数量,同时保持性能。研究者们通过在多个流行的大型语言模型和数据集上进行实验,证明了 RE-Adapt 和 LoRE-Adapt 在问答任务中的优越性能,无论是在闭书问答(closed-book QA)还是检索增强生成(retrieval-augmented generation, RAG)的场景下。此外,本文还探讨了部分适应(partial adaptation)技术,即通过调整适配器的缩放因子来控制适应强度,以及如何在不进行额外训练的情况下通过调整指令调优的强度来改善模型性能。实验结果表明,RE-Adapt 能够在新领域增加知识,同时不会降低模型在原有领域的性能。

观点

- 逆向工程适配器(RE-Adapter): 通过计算指令调优模型与预训练模型之间的参数差异,可以得到一个适配器,用于在新领域的数据上进行模型的微调,同时保持指令跟随的能力。

- 低秩变体 LoRE-Adapt: 利用 SVD 的低秩近似来减少适配器的参数数量,LoRE-Adapt 能够使用更少的参数实现与 RE-Adapt 相当或更好的性能。

- 部分适应(partial adaptation): 通过在推理时调整适配器的缩放因子,可以更好地控制适应的强度,从而提高模型在特定任务上的性能。

- 改善指令调优: 通过调整 RE-Adapter 的强度,可以在不进行额外训练的情况下改善指令调优模型的性能。

- 实验结果: RE-Adapt 和 LoRE-Adapt 在多个语言模型和数据集上的实验表明,这些方法在问答任务中优于传统的微调策略,能够在新领域增加知识,同时不会降低模型在原有领域的性能。

- 对 RAG 的影响: 即使在检索增强生成(RAG)的情况下,RE-Adapt 也能提高性能,表明即使在有检索外部知识的可能性的情况下,将新知识直接融入模型也是有益的。

- 知识恢复: RE-Adapt 的方法可能还能够恢复预训练阶段丢失的知识,因为它能够在不同程度的指令调优强度下改善模型的性能。

- 未来研究方向: 本文的研究为控制知识获取与通用问题解决能力之间的竞争优先级提供了新的方向。

- 限制与社会影响: 虽然本研究专注于问答任务,但它可能会影响未来的语言模型定制化方式,减少环境影响,并且没有明显的负面社会影响。

效果

Closed-book QA

结合 RAG

Leave a Reply